引言:云计算的第三次范式革命

随着Kubernetes成为容器编排的事实标准,云原生架构正推动云计算进入第三个发展阶段。Gartner预测,到2025年将有超过50%的新企业应用采用Serverless架构。这种无需管理基础设施的编程模型,正在重塑软件开发的全生命周期,从CI/CD流水线到事件驱动架构,从微服务拆分到成本优化策略,Serverless已成为数字转型的关键技术支柱。

一、Serverless技术原理剖析

1.1 核心架构组件

Serverless平台由三层核心架构构成:

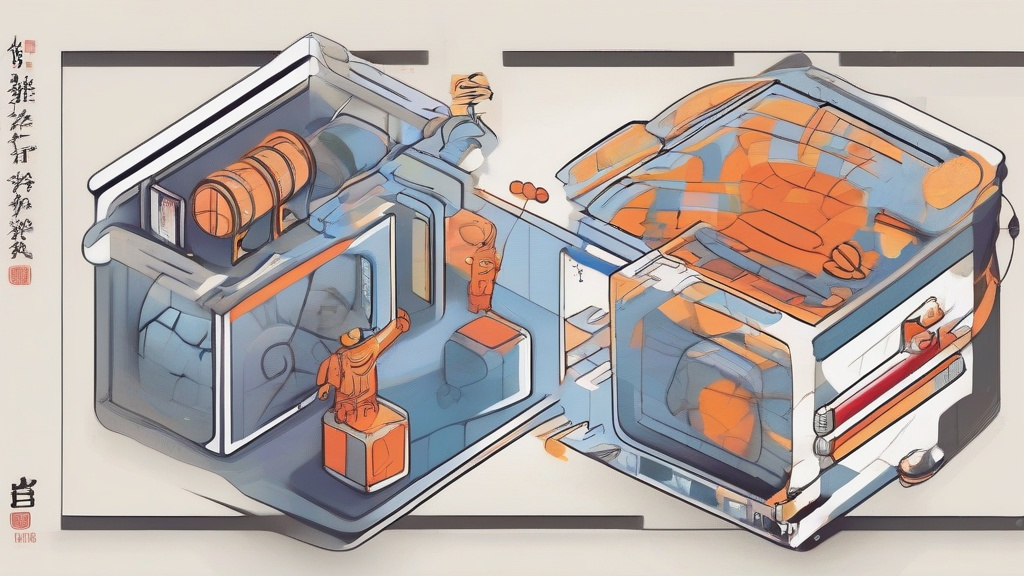

- 事件网关层:作为外部事件的统一入口,支持HTTP、定时任务、消息队列等20+种触发器类型。AWS API Gateway可实现毫秒级事件路由,单区域支持每秒百万级请求处理。

- 函数执行层:采用轻量级沙箱技术实现资源隔离,Firecracker微虚拟机将启动时间缩短至100ms以内,较传统容器提升5-10倍。Google Cloud Run通过gVisor实现安全隔离,内存开销降低40%。

- 资源调度层

动态扩缩容算法是核心专利技术,阿里云函数计算采用预测式预热+响应式扩缩容的混合模式,在双十一场景下实现99.99%的请求零冷启动。腾讯云SCF通过热点函数缓存机制,将常用函数实例保留时间延长至30分钟。

1.2 冷启动优化技术矩阵

| 技术类型 | 实现方案 | 效果指标 |

|---|---|---|

| 预置实例 | AWS Provisioned Concurrency | 冷启动降低90% |

| 函数预热 | 定时发送空请求保持实例 | 延迟波动<50ms |

| 语言优化 | Go语言编译执行 | 启动速度提升3倍 |

| 镜像加速 | OCI镜像分层缓存 | 拉取时间减少75% |

二、企业级应用场景实践

2.1 实时文件处理流水线

某视频平台采用Serverless架构重构转码服务:

- S3对象存储触发Lambda函数

- 函数调用FFmpeg进行H.265编码

- 处理结果写入DynamoDB元数据库

- 通过WebSocket推送至客户端

该方案实现90%的成本下降,资源利用率从30%提升至95%,支持4K视频的实时转码需求。

2.2 物联网数据清洗管道

工业传感器数据治理案例:

- 设备数据通过MQTT协议上传至IoT Core

- 规则引擎路由至Lambda进行异常检测

- 合格数据存入TimescaleDB时序库

- 异常数据触发SNS告警通知

通过Serverless的自动扩缩容特性,系统成功应对每日3亿条数据的峰值冲击,运维成本降低82%。

三、关键挑战与解决方案

3.1 性能瓶颈突破

在金融交易场景中,某银行遇到以下问题:

- 单函数执行超时限制(AWS Lambda为15分钟)

- VPC连接冷启动延迟(增加2-5秒)

- 并发执行数限制(默认1000并发)

解决方案:

- 采用Step Functions拆分长流程

- 启用VPC加速功能(ENA网卡)

- 申请服务配额提升并发上限

3.2 安全合规实践

医疗行业数据治理要求:

- HIPAA合规性要求数据加密

- PCI DSS要求网络隔离

- GDPR要求数据主权控制

实施策略:

// 加密配置示例(AWS KMS){ \"KmsKeyArn\": \"arn:aws:kms:us-east-1:123456789012:key/abcd1234-5678-90ef-ghij-klmnopqrstuv\", \"EncryptionMode\": \"SSE-KMS\"}通过私有子网部署、IAM最小权限原则、VPC端点隔离等措施,构建多层防御体系。

四、未来发展趋势展望

4.1 边缘计算融合

AWS Wavelength将Lambda函数部署至5G基站边缘,实现<10ms的延迟。Azure IoT Edge支持在网关设备上运行Serverless函数,构建分布式计算网络。这种架构在自动驾驶、工业AR等场景具有革命性意义。

4.2 AI推理优化

新兴的Serverless AI平台(如Cortex、BentoML)提供:

- 自动模型版本管理

- 动态批处理优化

- GPU资源池化

测试数据显示,在图像识别场景中,Serverless架构较传统K8s部署成本降低65%,推理延迟波动控制在±5ms以内。

4.3 WebAssembly集成

Cloudflare Workers率先支持WASM运行时,实现:

- C/C++/Rust代码直接部署

- 子毫秒级启动时间

- 跨平台二进制兼容

在加密计算场景中,WASM模块使数据解密速度提升3倍,同时保持内存安全隔离。

结语:重新定义云时代开发范式

Serverless正在推动软件开发从"资源管理"向"业务逻辑"回归。随着FaaS与BaaS服务的持续融合,开发者将更专注于价值创造而非基础设施运维。据IDC预测,2026年Serverless将占据公共云市场的28%份额,成为企业数字化转型的核心引擎。在这个技术变革的临界点,把握Serverless架构的设计原则与实践方法,将成为赢得云原生时代竞争的关键。