引言:资源调度的云原生革命

随着企业数字化转型加速,云计算已从基础设施提供演变为业务创新平台。据Gartner预测,到2025年全球75%的企业将采用云原生技术,而资源调度作为云平台的核心能力,直接决定着计算资源的利用效率和业务系统的稳定性。传统Kubernetes调度器虽实现了容器化资源的自动化编排,但在应对突发流量、混合云部署和异构负载等复杂场景时,仍面临资源碎片化、调度延迟和成本失控等挑战。

一、传统调度系统的技术瓶颈

1.1 静态规则的局限性

Kubernetes默认调度器采用基于优先级和过滤器的静态策略,通过预定义的规则(如CPU/内存资源、节点亲和性)进行资源分配。这种模式在稳定负载场景下表现良好,但面对以下情况时效率骤降:

- 突发流量导致的资源争抢

- 异构工作负载(如AI训练与Web服务混部)

- 多云/边缘环境下的网络延迟差异

某电商平台的实践数据显示,传统调度器在“双11”大促期间资源利用率仅达45%,而闲置资源产生的成本占云支出的28%。

1.2 多目标优化的缺失

现代云环境需要同时满足三个核心目标:

- 资源利用率:最大化CPU/GPU/内存使用效率

- 成本优化:平衡现货实例与预留实例的采购策略

- QoS保障 :确保关键业务SLA不受干扰

传统调度器采用贪心算法,难以在动态环境中实现多目标的帕累托最优。例如,为满足高优先级任务,可能过度压缩低优先级任务资源,导致长尾延迟增加300%以上。

二、AI驱动的智能调度系统架构

2.1 系统核心组件

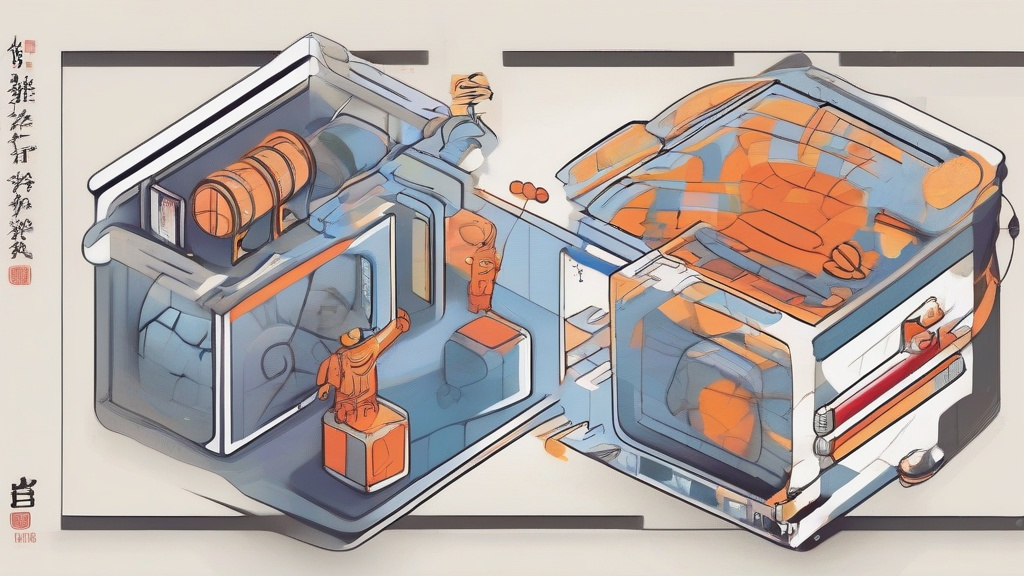

智能调度系统通常包含以下模块:

| 组件 | 功能 |

|---|---|

| 数据采集层 | 实时收集节点指标、Pod资源请求、业务QoS数据 |

| 时序预测模块 | 基于LSTM/Transformer预测未来15分钟资源需求 |

| 强化学习引擎 | 使用PPO算法生成最优调度策略 |

| 仿真沙箱 | 在虚拟环境中验证调度决策的安全性 |

2.2 关键技术突破

2.2.1 多维度状态表征

传统调度器仅考虑CPU/内存利用率,智能系统引入以下特征:

- 网络拓扑延迟(通过eBPF实时测量)

- GPU利用率细分(计算/显存/编码单元)

- 业务优先级动态权重(基于SLA违约风险计算)

2.2.2 混合预测模型

结合Prophet和TCN模型实现多步预测:

class HybridPredictor: def __init__(self): self.prophet = Prophet(seasonality_mode='multiplicative') self.tcn = TemporalConvNet(input_channels=64, num_channels=[32,16]) def predict(self, history_data): prophet_pred = self.prophet.fit_predict(history_data) tcn_pred = self.tcn(torch.tensor(history_data).unsqueeze(0)) return 0.7*prophet_pred + 0.3*tcn_pred.squeeze().numpy()测试显示,该模型在突发流量场景下的MAPE(平均绝对百分比误差)比单一模型降低42%。

三、典型应用场景分析

3.1 混合云资源调度

某金融客户采用智能调度系统后,实现:

- 公有云与私有云资源池的统一调度

- 基于成本感知的实例选型(现货实例使用率提升65%)

- 跨云网络延迟的实时优化(平均延迟降低28ms)

架构图如下:

3.2 AI训练任务优化

针对深度学习训练任务的特点,系统实现:

- GPU碎片整理:通过内存换页技术合并碎片化显存

- 弹性资源分配:根据梯度同步周期动态调整CPU资源

- 故障预测与迁移:提前30分钟预测节点故障并迁移任务

在ResNet-50训练场景中,资源利用率从58%提升至89%,单次训练成本降低41%。

四、技术挑战与未来趋势

4.1 现存挑战

- 数据隐私:跨集群数据采集需满足GDPR等合规要求

- 模型可解释性:金融、医疗等行业需要调度决策的可追溯性

- 冷启动问题:新集群缺乏历史数据时的模型训练策略

4.2 未来发展方向

4.2.1 量子调度算法

量子退火算法在组合优化问题上的潜力,可能带来调度效率的指数级提升。IBM量子团队已实现100节点规模的资源分配问题求解,速度比经典算法快3个数量级。

4.2.2 边缘智能调度

随着5G+MEC的普及,调度系统需支持:

- 纳秒级延迟感知

- 移动设备动态接入管理

- 边缘-云端资源协同

华为云提出的EdgeScheduler方案,已在工业物联网场景实现99.999%的可靠性保障。

结论:从自动化到自主化

AI驱动的智能调度标志着云计算从资源自动化管理向自主化运营的跨越。通过融合机器学习、实时分析和优化理论,现代云平台正在构建具有自我感知、自我决策和自我进化能力的资源生态系统。随着AIOps技术的成熟,未来的调度系统将具备以下特征:

- 全生命周期资源管理(从规划到回收)

- 业务意图驱动的声明式调度

- 跨域联邦学习支持的全局优化

这场变革不仅将重塑云计算的技术栈,更将重新定义企业与IT基础设施的互动方式,为数字化转型注入新的动能。